De acordo com o preprint RedSage: A Cybersecurity Generalist LLM, de Naufal Suryanto, Muzammal Naseer e colegas, já não basta perguntar se um modelo de linguagem sabe definir malware, phishing ou CVE. A questão agora é outra. Um modelo aberto, relativamente pequeno e implantável localmente consegue de fato operar melhor no universo da cibersegurança do que assistentes gerais mais famosos e maiores? Os autores dizem que sim. O RedSage, um modelo de 8 bilhões de parâmetros voltado para segurança ofensiva, defensiva e uso de ferramentas, teria superado rivais abertos em benchmarks especializados e, em alguns cenários, chegado perto de modelos muito maiores.

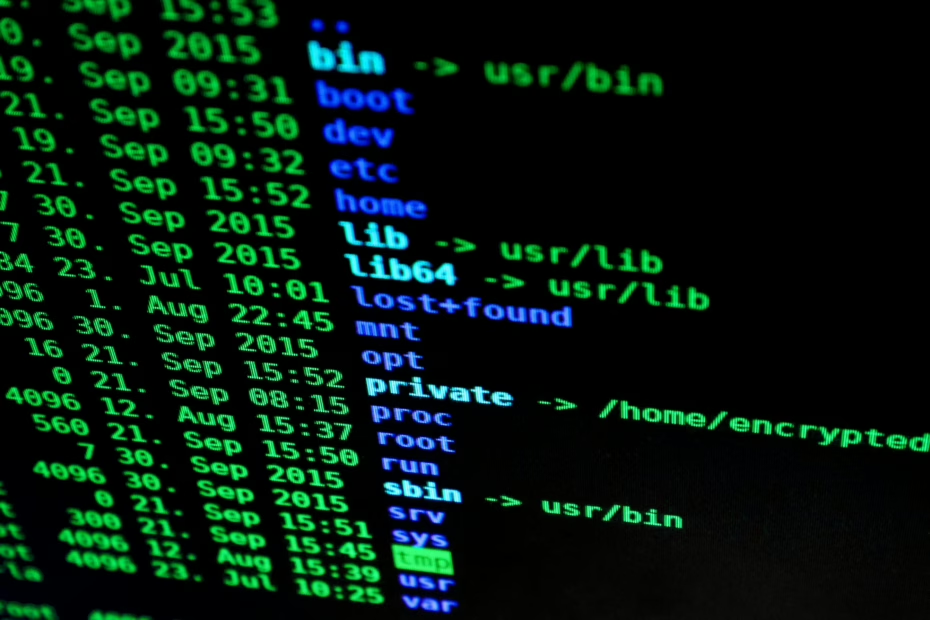

A tese do artigo é ambiciosa, mas faz sentido dentro do momento atual da IA. Equipes de segurança querem ajuda automatizada para tarefas como interpretação de alertas, análise de vulnerabilidades, leitura de documentação técnica, geração de comandos, resumo de relatórios e apoio em investigação. Contudo, existe um problema prático. Enviar logs, código-fonte, artefatos internos e incidentes sensíveis para APIs proprietárias em nuvem pode ser inviável em muitos contextos. Isso explica o apelo de um modelo aberto e executável localmente, em ambiente on-premise, isto é, rodando dentro da própria infraestrutura da organização.

O preprint chama atenção porque não apresenta apenas um modelo. Ele apresenta um pacote inteiro. Há um corpus de pré-treinamento filtrado para cibersegurança, um conjunto curado de fontes especializadas, uma etapa de geração sintética de diálogos técnicos e um novo benchmark para avaliar conhecimento, habilidade prática e familiaridade com ferramentas. Em outras palavras, os autores não estão vendendo apenas um chatbot de segurança. Estão propondo uma receita para treinar e medir esse tipo de sistema.

O que o RedSage tenta resolver

A crítica central do artigo aos modelos existentes é simples. Muitos sistemas ajustados para cibersegurança ou dependem de infraestrutura fechada, com riscos de privacidade e pouca reprodutibilidade, ou permanecem excessivamente genéricos, com desempenho limitado quando a conversa exige domínio de frameworks, comandos de terminal, Kali Linux, taxonomias de ameaças e fluxos reais de trabalho. Segundo os autores, faltava um modelo generalista em cibersegurança. Generalista aqui não significa superficial. Significa um sistema capaz de circular entre conhecimento conceitual, procedimentos práticos e uso de ferramentas sem desmoronar ao sair da simples pergunta de múltipla escolha.

Essa distinção importa. Modelos grandes costumam ir bem quando a tarefa é reconhecer siglas, recordar definições ou completar padrões vistos em massa na Internet. A vida real da segurança, no entanto, não é só isso. Ela envolve documentação fragmentada, instruções de linha de comando, análise contextual de vulnerabilidades, interpretação de técnicas ofensivas, leitura de manuais e capacidade de responder em formato útil. O RedSage quer ocupar justamente esse espaço intermediário entre conhecimento enciclopédico e utilidade prática.

Como o modelo foi construído

A construção do RedSage começa com uma filtragem em larga escala do FineWeb, um gigantesco corpus derivado da web pública. Os autores treinam um classificador baseado em ModernBERT para separar conteúdo de cibersegurança do restante da Internet. Desse processo emerge uma piscina inicial de 125 milhões de documentos e 89,8 bilhões de tokens potencialmente relevantes. Depois entram deduplicação, mistura com conteúdo educacional geral e restrições de custo computacional. O resultado final do pré-treinamento contínuo fica em 11,7 bilhões de tokens.

Só isso já seria um projeto grande. Contudo, os autores partem do princípio correto de que volume não resolve sozinho o problema da qualidade. Por isso, montam também o RedSage-Seed, um conjunto curado com 28.637 amostras e cerca de 150 milhões de tokens, organizado em três blocos. O primeiro cobre conhecimento estruturado, com fontes como MITRE e OWASP. O segundo cobre habilidades, com write-ups de pentest, técnicas de exploração e tutoriais. O terceiro cobre ferramentas, com cheat-sheets de linha de comando, manuais Linux e documentação de ferramentas do Kali.

A etapa mais interessante do artigo aparece logo depois. Os autores usam um pipeline agentic, termo em inglês que, neste contexto, descreve uma cadeia automatizada com agentes especializados em planejar e gerar exemplos. Um agente planejador lê o material de origem, identifica quais competências podem ser ensinadas e decide como transformar aquele conteúdo em tarefa conversacional. Outro agente gera diálogos de múltiplas rodadas, com papéis e respostas técnicas aterradas no material original. Esse processo produz 266 mil conversas de ajuste supervisionado, cobrindo conhecimento, habilidades e ferramentas.

A ideia é engenhosa porque evita a limitação de muitos datasets manuais pequenos e também tenta escapar da pobreza de exemplos sintéticos pouco realistas. Em vez de pedir a um modelo que invente perguntas genéricas sobre segurança, o pipeline reaproveita materiais concretos e os converte em interações que lembram mais o cotidiano de um analista ou operador técnico. Ainda assim, isso introduz uma tensão importante. Sempre que LLMs são usados para gerar grande parte do material de treinamento e avaliação, surge o risco de amplificar vieses de formulação e de premiar sistemas bons em imitar o estilo do dataset, não necessariamente bons em resolver problemas no mundo real.

O benchmark é parte da história

O artigo não para no treinamento. Ele também propõe o RedSage-Bench, um benchmark com 30 mil questões de múltipla escolha e 240 perguntas abertas. A ambição aqui é corrigir uma lacuna real da literatura. Muitos benchmarks anteriores medem apenas lembrança factual. O RedSage-Bench tenta cobrir também habilidades ofensivas e proficiência em ferramentas, o que inclui tarefas ligadas a CLI e Kali Linux.

Os autores descrevem um processo de verificação em múltiplos estágios, com filtragem estrutural, checagem de qualidade, amostragem balanceada, deduplicação semântica para reduzir vazamento entre treino e teste e auditoria humana nas questões abertas. Isso é melhor do que simplesmente despejar perguntas sintéticas e declarar vitória. Contudo, a limitação continua evidente. Parte substancial do benchmark nasce de geração por modelos e parte da avaliação aberta depende de LLM-as-judge, isto é, um modelo usado como avaliador automático. Isso é útil para escalar testes. Não é a mesma coisa que validação extensa com especialistas independentes, em tarefas reais, sob pressão operacional.

O que os resultados sugerem

Nos testes do próprio RedSage-Bench, os números são fortes. Em múltipla escolha, o RedSage-8B-Ins chega a 85,73% de acerto médio, acima do Qwen3-8B, que fica em 81,85%. Nas perguntas abertas, a variante alinhada com DPO, sigla para Direct Preference Optimization, uma técnica de alinhamento por preferências, supera a segunda melhor em correção média por cerca de 7 pontos percentuais absolutos e também lidera em qualidade de resposta. O detalhe mais relevante talvez esteja na distribuição por categoria. Conhecimento puro é a parte mais fácil. Ferramentas continuam sendo o ponto mais difícil. Isso é coerente com a prática. Decorar conceitos é mais simples do que responder bem quando entram comandos, sintaxe, contexto e variações operacionais.

Nos benchmarks externos de cibersegurança, o quadro continua favorável ao RedSage. Em configuração instruct, a variante RedSage-8B-Ins atinge média de 81,30%, enquanto o Qwen3-8B fica em 75,71%. O ganho chega a 5,59 pontos, dependendo da variante comparada. O resultado é interessante por dois motivos. Primeiro, porque indica que o sistema não está simplesmente decorando o benchmark criado pelos autores. Segundo, porque ele se aproxima do Qwen3-32B, um modelo muito maior, que alcança 82,31%. Já o GPT-5 ainda aparece acima, com 86,29%, o que impede qualquer leitura triunfalista do tipo “o aberto venceu o fechado”. Não venceu. Mas encurtou a distância de forma respeitável.

Talvez o dado mais surpreendente esteja fora da cibersegurança estrita. Em benchmarks gerais do Open LLM Leaderboard, o RedSage-8B-DPO chega a média de 74,33% e supera o Qwen3-32B, que marca 73,17%. Isso sugere que especialização de domínio não precisa degradar competência geral, algo que já foi observado em outros contextos quando o ajuste é mal conduzido. Os autores usam esse ponto para defender que seu pipeline melhora não apenas conhecimento de segurança, mas também raciocínio geral e seguimento de instruções.

Por que o estudo importa

O valor do preprint vai além do placar entre modelos. A contribuição mais séria está em mostrar que, para IA especializada, dados e avaliação importam tanto quanto escala bruta. O RedSage não nasce de um truque mágico de arquitetura. Ele nasce de seleção de corpus, curadoria manual, mistura entre conhecimento geral e técnico, geração de diálogos orientada por tarefa e um benchmark mais ambicioso do que a maioria dos concorrentes. Isso é intelectualmente mais interessante do que o discurso repetitivo de que basta treinar um modelo maior.

Também há um ponto estratégico importante. Se modelos de 8 bilhões de parâmetros, treinados com foco e boa curadoria, conseguem chegar perto de sistemas muito maiores em tarefas especializadas, então a corrida por utilidade prática pode se deslocar parcialmente da escala absoluta para a qualidade da adaptação de domínio. Para cibersegurança isso é especialmente relevante, porque privacidade, custo e soberania computacional pesam mais do que em muitos outros usos de IA.

O que o preprint ainda não prova

Ao mesmo tempo, seria um erro ler o artigo como prova de que já temos um analista de segurança confiável, pronto para produção. Não temos. O próprio texto é cauteloso ao afirmar que o modelo é lançado para pesquisa e não deve ser usado em operações reais sem guardrails adicionais. Essa cautela é justificada. O estudo mede desempenho em benchmarks, não desempenho em um SOC real, em uma investigação de incidente complexa ou em um fluxo vivo de resposta a ameaça.

Também há um problema metodológico que merece ser dito com clareza. O pipeline inteiro depende bastante de LLMs geradores e verificadores. Isso pode ser eficiente, mas cria um ecossistema em que modelos ensinam, refinam e avaliam outros modelos. Mesmo com auditoria humana em partes do processo, sempre existe a chance de que certas preferências de estilo, estrutura de resposta e noções de “boa resposta” acabem circulando de forma autorreferente. Em outras palavras, o benchmark pode capturar competência real em alguma medida. Também pode, em outra medida, capturar alinhamento com a gramática interna do próprio pipeline.

Existe ainda a questão do dual use, expressão em inglês usada para tecnologias que podem servir tanto a aplicações legítimas quanto abusivas. Como o RedSage inclui conhecimento ofensivo, documentação de ferramentas e material de exploração, o risco de uso impróprio é inerente ao projeto. Os autores reconhecem isso explicitamente. Esse reconhecimento é importante. Não resolve o problema. Apenas mostra que a equipe sabe que uma IA treinada para falar com naturalidade sobre técnicas ofensivas não é uma ferramenta neutra.

Outro detalhe que merece atenção está na própria política de abertura. O artigo afirma que parte dos materiais curados pode incluir conteúdo publicamente acessível, mas protegido por direitos autorais, e que esses itens não serão redistribuídos sem permissão. Isso significa que a promessa de abertura total precisa ser lida com alguma precisão. O projeto é aberto na intenção e em parte da implementação. Ainda resta ver, na prática, quanto do pipeline poderá ser reproduzido integralmente por terceiros sem atrito jurídico ou técnico.

O ponto central não é só o RedSage

No fim das contas, o preprint é menos uma prova definitiva de superioridade de um modelo e mais uma demonstração de rumo. Ele mostra que uma IA aberta para cibersegurança pode melhorar de forma substancial quando deixa de ser treinada como enciclopédia genérica e passa a ser tratada como sistema especializado, com corpus próprio, tarefas próprias e critérios próprios de avaliação. Isso é um avanço real.

Contudo, o teste decisivo ainda está por vir. A pergunta que realmente importa não é se o RedSage vence um benchmark por alguns pontos. A pergunta é se ele continua útil, confiável e calibrado quando sai do papel e encontra ambientes confusos, documentação incompleta, sinais contraditórios, risco de alucinação e custo alto de erro. O preprint avança bastante na direção certa. Só não deve ser confundido com a linha de chegada.