Pesquisadores do MIT analisaram como modelos de inteligência artificial generativa (IA), apesar de sua capacidade impressionante de realizar tarefas como escrever poemas ou criar programas de computador, não demonstram uma compreensão coerente do mundo. Esses modelos, baseados em transformers, são treinados para prever palavras subsequentes em textos, mas um estudo recente mostra que eles podem executar tarefas complexas, como fornecer direções quase perfeitas em Nova York, sem formar um mapa interno preciso da cidade.

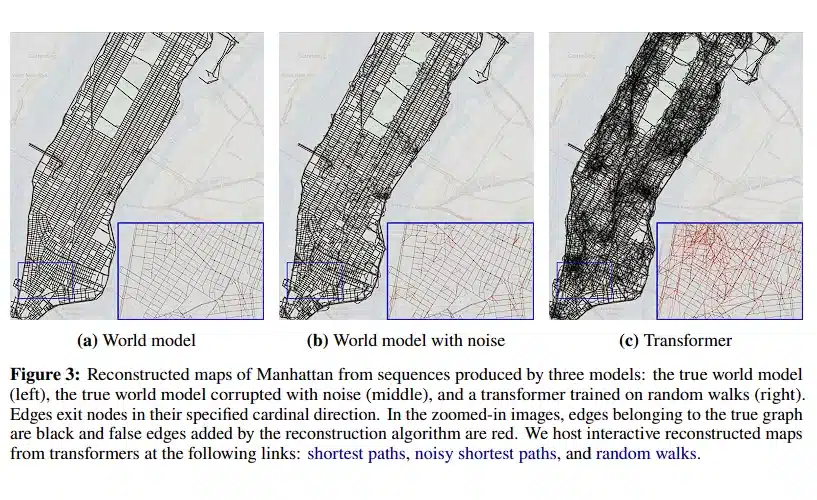

O estudo revelou que, embora os modelos possam navegar eficazmente em condições normais, seu desempenho cai drasticamente diante de mudanças inesperadas, como ruas fechadas ou desvios. Ao examinar os mapas gerados por esses modelos, os pesquisadores notaram ruas inexistentes que conectam cruzamentos distantes de forma irrealista, indicando que os modelos não possuem uma representação fiel do ambiente. Isso tem implicações preocupantes para a aplicação prática da IA, pois tarefas que parecem funcionar bem em certos contextos podem falhar em cenários ligeiramente diferentes.

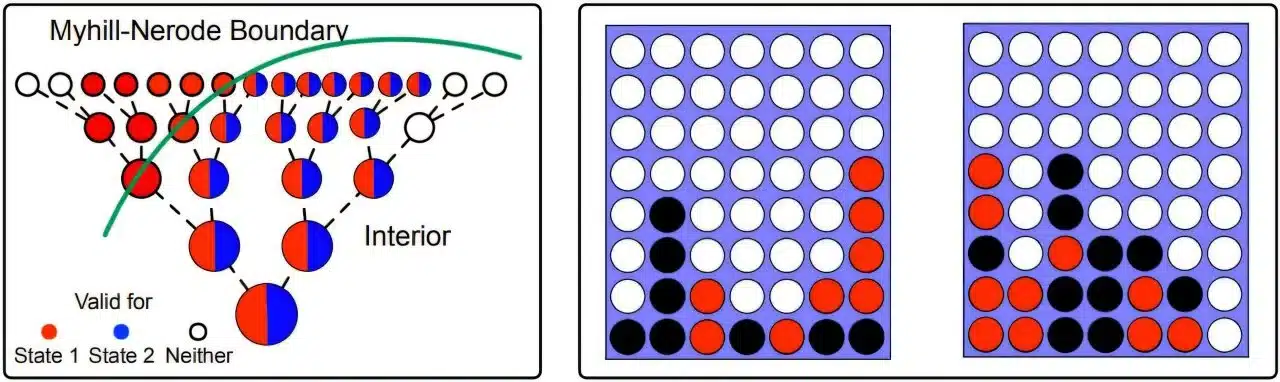

Para avaliar se esses modelos formam uma compreensão coerente do mundo, os pesquisadores desenvolveram duas novas métricas: distinção de sequência e compressão de sequência. A distinção avalia a capacidade de um modelo de reconhecer diferenças entre estados distintos, enquanto a compressão verifica se o modelo reconhece que estados idênticos compartilham os mesmos próximos passos possíveis. Usando essas métricas, os pesquisadores testaram a habilidade de modelos baseados em transformers em resolver problemas como navegação urbana e o jogo de tabuleiro Othello.

Os testes mostraram que modelos treinados com dados aleatórios formaram representações do mundo mais precisas do que aqueles treinados com estratégias estruturadas. Isso ocorre porque a aleatoriedade expõe o modelo a uma gama mais ampla de possibilidades. Apesar disso, nenhum dos modelos testados conseguiu formar um modelo coerente do mundo em todas as situações avaliadas, especialmente na navegação urbana, onde desvios simples causaram uma queda acentuada no desempenho.

Ao investigar os mapas criados pelos modelos, os pesquisadores encontraram representações fantasiosas de Nova York, com ruas imaginárias cruzando o grid urbano e orientações impossíveis. Esses resultados mostram que, embora os modelos possam executar tarefas complexas, isso não significa que compreendem as regras subjacentes. Para desenvolver IAs que capturem modelos precisos do mundo, os cientistas precisam adotar abordagens diferentes.

No futuro, os pesquisadores pretendem ampliar a análise para problemas com regras parcialmente conhecidas e aplicar essas métricas em cenários científicos do mundo real. Eles destacam a importância de questionar suposições sobre a capacidade da IA de compreender o mundo, evitando confiar apenas na intuição para avaliar o desempenho dos modelos.