Por Mario Bunge

Publicado originalmente por Mario Bunge em Matter and Mind: A Philosophical Inquiry.

Resumo: Neste ensaio, Mario Bunge critica o computacionalismo forte e examina os limites da analogia entre cérebro e computador. O autor argumenta que processos mentais centrais, como criatividade, formulação de problemas e cognição situada, não podem ser reduzidos a execução de algoritmos. A análise também distingue problemas diretos e inversos para mostrar por que tarefas científicas mais profundas escapam de abordagens puramente programáveis. Por fim, o texto defende uma psicologia e uma neurociência ancoradas em bases biológicas e filosóficas mais robustas, em vez de metáforas computacionais simplificadoras.

Os filósofos do início da modernidade, particularmente Descartes, consideravam a mente como o motor do raciocínio. Eles ignoravam a motivação e a emoção. A versão contemporânea dessa visão ultrarracionalista é o computacionalismo, a tese de que todos os processos mentais são computações.

De um ponto de vista filosófico, o computacionalismo apresenta duas variedades, a materialista e a idealista. A primeira afirma que cérebros são computadores (por exemplo, Churchland e Sejnowski 1993, McCulloch 1965). Em contraste, o computacionalismo idealista sustenta que a mente ou é um computador ou é uma coleção de programas de computador e, em qualquer caso, é separável do “hardware” anatômico (Putnam 1960, Pylyshyn 1984). Esta é frequentemente chamada de tese da “realizabilidade múltipla”.

Em qualquer das versões, o computacionalismo é a fase mais recente da psicologia do processamento de informação que deslocou o behaviorismo nos anos 1960 e que caracteriza a ciência cognitiva sem cérebro, ainda a escola dominante na psicologia. Assim, o computacionês é apenas um dialeto do informacionês.

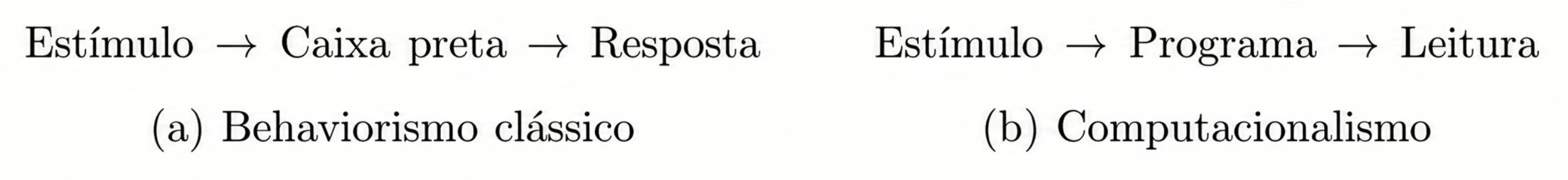

De uma perspectiva histórica, o computacionalismo é uma versão sofisticada do behaviorismo, pois apenas interpola o programa de computador entre o estímulo e a resposta e não considera os programas novos como criações cerebrais. Veja a Fig. 1.

Fig. 1 (a) Behaviorismo clássico: Estímulo → Caixa preta → Resposta. (b) Computacionalismo: Estímulo → Programa → Resultado.

A raiz do computacionalismo é, naturalmente, a similaridade real entre cérebros e computadores e, correspondentemente, entre a inteligência natural e a artificial. Os dois são de fato similares porque os artefatos em questão foram projetados para executar análogos de certas funções cerebrais. E o programa computacionalista é um exemplo da estratégia de tratar similares como idênticos. A história da ciência e da tecnologia mostra que essa estratégia fracassa aproximadamente tantas vezes quanto é bem-sucedida. A mesma história também mostra que o sucesso frequentemente cega para o fracasso. Observemos rapidamente a analogia cérebro-computador de um ponto de vista filosófico.

O computacionalismo levanta pelo menos três problemas de interesse para os filósofos: as capacidades e limitações dos computadores, os aspectos nos quais os computadores imitam com sucesso os cérebros e o grau em que a ciência da computação teórica pode fazer as vezes de psicologia teórica. Enfrentemos esses três problemas.

1. Os computadores raciocinam?

Todos admitem que, enquanto as pessoas podem sentir e raciocinar, os computadores não podem sentir coisa alguma. Contudo, a maioria das pessoas acredita que os computadores, ou melhor, os programas de computador, são os maiores pensadores de todos os tempos: os raciocinadores mais precisos, mais rápidos e os únicos infalíveis. Há alguma verdade nisso, embora não muita. Em primeiro lugar, a maioria dos processos mentais não são computações: são desejos, esperanças, medos, imagens e outros itens não proposicionais (Mellor 1991). Em segundo lugar, os computadores são severamente limitados até mesmo no âmbito proposicional. Por exemplo, são incapazes de detectar problemas ou inventar quaisquer programas ou, a fortiori, as ideias envolvidas neles (Bunge 1956a). Sem algoritmo, sem computação.

O engenhoso e conhecido argumento do Quarto Chinês de John Searle (1980) deveria persuadir qualquer um de que os computadores são motores puramente sintáticos: o significado (referência com sentido) lhes escapa por projeto. Gregory Chaitin (2006, 7), o conhecido cientista da computação da IBM, colocou da seguinte forma: as linguagens de programação de computadores “são formalismos para computar e calcular, não para raciocinar, não para provar teoremas e, muito enfaticamente, não para inventar novos conceitos matemáticos nem para fazer novas descobertas matemáticas”.

Todavia, um entusiasta dos computadores poderia levantar a seguinte objeção, como Hilary Putnam fez certa vez em uma conferência: embora os computadores atuais sejam de fato limitados, nada garante que essa limitação não será superada no futuro, porque a mente não é nada além de um conjunto de programas de computador. Vejamos. Uma invenção original é um processo em duas fases: concepção e realização. A concepção é uma representação ou descrição do artefato desejado, e a realização é a construção deste último. No caso de um artefato conceitual, como uma teoria ou um programa de computador, as duas fases coincidem: o artefato emerge à medida que está sendo descrito. E, naturalmente, por definição de “original”, uma concepção original é aquela que nunca foi descrita antes, isto é, uma que é até então desconhecida. Assim, a tarefa de inventar uma ideia radicalmente nova, como um programa de computador inédito, é tão difícil quanto a tarefa de tentar encontrar o Santo Graal: tudo o que se sabe é o uso ou a função que ele desempenharia se estivesse disponível.

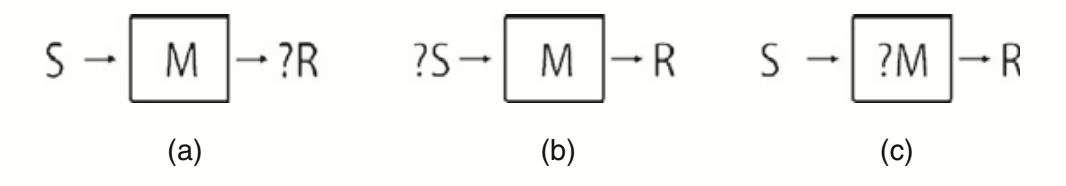

Mais precisamente, o inventor enfrenta um problema inverso difícil: dado o resultado desejado, projetar um artefato capaz de produzi-lo. E este é, naturalmente, um problema subdeterminado e, portanto, mal posto, que requer criatividade muito além do alcance de qualquer coisa que funcione por regras, da forma como as máquinas conhecidas supostamente funcionam. De fato, os algoritmos podem lidar apenas com problemas diretos, como calcular o próximo estado de uma máquina de Turing dadas sua função de próximo estado, seu estado atual e sua entrada. Um problema direto bem posto, se for solúvel, tem uma única solução. Em contraste, um problema inverso é aberto: tem ou múltiplas soluções ou nenhuma e, se for solúvel de algum modo, requer truques ad hoc, como suposições especiais adicionais (ver Bunge 2006).

Exemplos familiares de problemas inversos são: encontrar o epicentro de um terremoto, o centro de dispersão de uma bioespécie e a fonte de uma epidemia, localizar um lugar a partir do qual uma coisa dada possa se tornar visível, identificar as causas de uma síndrome médica e adivinhar as intenções por trás de um comportamento humano.

O exemplo histórico mais famoso de problema direto é: dado um sistema mecânico e suas equações de movimento, computar suas órbitas. O problema inverso correspondente é o de Newton: dadas as órbitas de um sistema mecânico, encontrar suas equações de movimento. Enquanto o problema direto pode demandar algum talento, resolver sua contraparte inversa exigiu o Newton. Veja a Fig. 2.

Fig. 2 (a) Problema direto: Dados o mecanismo M e as entradas S, encontrar as saídas R. (b) Problema inverso: Dados o mecanismo e as saídas, encontrar as entradas. (c) Problema inverso difícil (identificação): Dadas as entradas e as saídas, encontrar um mecanismo.

É um artigo de fé científica e tecnológica que, em princípio, todos os problemas diretos bem postos, por mais difíceis que sejam, são solúveis. Nenhuma fé desse tipo é possível em relação aos problemas inversos, porque eles são em princípio mal postos: seu enunciado é incompleto e, consequentemente, eles demandam suposições extras. E, como suposições não podem ser programadas, os problemas inversos estão além do alcance dos programas de computador. Ora, os problemas mais interessantes e exigentes na ciência, na engenharia, na tecnologia social, nas humanidades e na vida cotidiana são do tipo inverso.

Basta pensar no problema de inventar uma teoria para dar conta de uma massa de dados empíricos, de projetar um artefato para realizar uma tarefa nova, de conceber um programa de governo visando resolver um dado conjunto de problemas sociais ou de identificar o autor de um texto não assinado (ou pintura, ou partitura musical, ou artigo científico, ou projeto tecnológico, ou artefato). Em outras palavras, os problemas mais intrigantes e difíceis, em todos os campos, são inversos e, portanto, estão além do alcance da tecnologia computacional. Mais curto: as tarefas mais importantes não são programáveis. Ou, para colocar cinicamente: tudo o que é programável é trivial, ainda que trabalhoso.

Evidentemente, uma vez que uma tarefa tenha sido programada, ela pode exigir perícia, mas não capacidade cerebral original. Por exemplo, existe um algoritmo para descobrir regularidades de sistemas mecânicos particulares a partir de dados sobre seus movimentos (Schmidt e Lipson 2009). Contudo, as equações resultantes não envolvem variáveis de alto nível, como massa, momento e energia, e não cobrem todos os sistemas mecânicos possíveis, como a mecânica teórica faz, de modo que são inúteis para enfrentar novos problemas. A ciência não pode ser automatizada, mas muitos procedimentos científicos que consomem tempo, como sequenciar genomas e detectar partículas raras e novas em um colisor, podem ser automatizados uma vez que os algoritmos correspondentes tenham sido inventados.

Ainda assim, frequentemente se alega que todas as limitações dos computadores atuais poderiam ser superadas no futuro. Naturalmente, a prudência aconselha nunca dizer que algo não pode ser feito. Mas o problema em questão é lógico, não empírico. De fato, as expressões “espontaneidade programada”, “criatividade programada” e “programação automatizada” são oximoros, pois é em princípio impossível programar uma tarefa completamente desconhecida ou inventar uma ideia da qual não se tem a menor pista.

Para usar a conhecida distinção de Cattell (1987), pode-se admitir que os computadores são capazes de “raciocínio cristalizado”, ao mesmo tempo em que se nega que possam se engajar em “raciocínio fluido”, que é a capacidade de enfrentar novos problemas. De fato, nenhum computador pode ser autoativado: ele só pode ser ativado por um programa de computador, e cada programa desse tipo é uma prescrição detalhada e precisa para atingir um objetivo de um tipo conhecido com meios de um tipo conhecido. Seria como ordenar que um macaco projetasse um software.

Para entrar em um detalhe técnico, uma computação é o que uma máquina de Turing faz. E isso consiste em a máquina passar por uma sequência finita de configurações que se sucedem umas às outras de acordo com regras precisas. E uma dessas regras estipula que um computador permanecerá no mesmo estado a menos que receba um estímulo. Em outras palavras, os computadores carecem de espontaneidade ou livre-arbítrio: eles estão à mercê de seus usuários. Em particular, carecem da plasticidade, da liberdade e da força de vontade necessárias para decidir aprender itens novos submetendo-se voluntariamente a um exigente aprendizado.

Assim, ao contrário de um computador que foi seriamente danificado, o cérebro de uma pessoa que sofreu uma lesão severa, como um derrame, um ferimento de bala ou a remoção cirúrgica de uma parte substancial, pode recuperar a função perdida em certa medida: pode aprender a andar com pernas protéticas, pode reaprender a falar e a calcular, e assim por diante. Tal capacidade de autorreparo está além de qualquer máquina.

Naturalmente, pode-se imaginar robôs cirurgiões, enfermeiros e professores capazes de diagnosticar e reparar máquinas danificadas. Mas eles não seriam artefatos autorreparadores, e seriam programados por outros em vez de autoprogramados. É aqui que entra a distinção de Kant entre o agente autônomo e o heterônomo.

O enorme poder dos computadores digitais reforçou o materialismo mecanicista, enquanto suas limitações encorajaram os idealistas. Na matemática, esse conflito se traduz como o debate entre aqueles que acreditam que toda a matemática pode ser capturada por sistemas formais e aqueles que enfatizam o aspecto criativo e, portanto, imprevisível do trabalho matemático. Na verdade, não há necessidade de tomar partido nessa questão, porque cada um dos contendores está parcialmente certo: na matemática há tanto invenção quanto descoberta (ou postulação e prova) e, consequentemente, a atitude correta “abarca tanto o ponto de vista mecanicista quanto o antimecanicista” (Feferman 2009). E tal compromisso não envolve restringir o materialismo: ele apenas implica admitir que a máquina de Turing não é um verdadeiro modelo do cérebro humano, nem que seja porque, ao contrário da máquina, o cérebro é espontâneo e criativo.

2. A metáfora do computador

Lê-se com frequência na literatura psicológica que os animais “computam” cada fragmento de experiência, seja ver ou suar, saltar ou sentir sede, escolher ou decidir, descobrir ou inventar, e assim por diante. Mas certamente isso é apenas uma metáfora, uma vez que computações propriamente ditas são operações sobre símbolos, enquanto as operações mentais são processos em sistemas neurais, que são feitos de células vivas que se comunicam por meio de sinais físicos ou químicos, não símbolos. Estes são artefatos e, ademais, os primeiros símbolos foram inventados não mais do que cerca de 30 mil anos atrás, quando nossa espécie já existia há aproximadamente 100 mil anos. É, portanto, chocante ler que “deve haver um mecanismo endereçável de leitura e escrita nos cérebros que codifica em símbolos a informação recebida” (Gallistel e King 2009). Somente o Espírito Santo poderia competir com o mistério do milagre dos símbolos incrustados nos cérebros antes de terem sido inventados.

A alegação adicional de que a neurociência tenta “descobrir os algoritmos usados no cérebro” (Sejnowski et al. 1988, 1300) não é menos intrigante, uma vez que um algoritmo é, por definição, uma regra para calcular algo, como o logaritmo de um número, enquanto o cérebro “usa” leis biológicas. Da mesma forma, os planetas não computam suas próprias órbitas, mas “usam” (ou “vêm com”) as leis de Kepler, que são regularidades naturais, não regras para processar informação. Consequentemente, a busca por logaritmos no cérebro não instruído é similar à busca por madeira na célula com base na doutrina tradicional chinesa dos cinco elementos, um dos quais seria a madeira.

Como são artefatos, os algoritmos não podem ser descobertos: eles precisam ser inventados. E a invenção é tudo menos uma atividade dirigida por regras: é uma arte. Em particular, não pode haver algoritmos para projetar algoritmos, assim como não pode haver regras para criar obras de arte originais. A razão é óbvia: por definição, qualquer tarefa dirigida por regras é rotineira, e não original.

Compare-se a neurociência computacional com a física ou a química computacional. Um físico ou químico computacional projeta e usa programas de computador para computar funções, ou resolver equações, que são conhecidas ou se espera que representem traços físicos, como níveis de energia atômica ou molecular. Ele é um físico ou químico teórico (ou melhor, matemático) que usa ferramentas mais avançadas do que papel e lápis. Em contraste, um neurocientista computacional modela “estruturas” cerebrais (órgãos, regiões) como computadores. Portanto, ele busca algoritmos incorporados nas redes neurais: ele compartilha a crença pitagórica de que o mundo, ou pelo menos o cérebro, é feito de objetos matemáticos. Por exemplo, ele pode afirmar que o cérebro não instruído realiza inferências bayesianas: que ele atribui arbitrariamente valores iniciais de probabilidade (“priors”) e computa probabilidades posteriores usando o teorema de Bayes, em que “probabilidade” é equiparada a grau de crença. Para mim, isso soa como sustentar que planetas computam a probabilidade subjetiva prévia de impacto de meteorito e regulam sua velocidade angular para evitar a catástrofe. Sugiro, em vez disso, que o cérebro computa apenas quando de fato computa.

Mais precisamente, submeto que uma ciência-X computacional pode pesquisar qualquer um de dois possíveis projetos de pesquisa:

(A) Projetar programas de computador e simulações para resolver problemas matemáticos que surgem na ciência-X teórica (ou matemática), que por sua vez tenta modelar fatos-X.

(B) Descobrir os algoritmos que espreitam nos fatos-X.

Submeto ainda que, enquanto o projeto A está sendo executado com sucesso na física e na química, o projeto B é altamente problemático, para não dizer descabido.

Ademais, a metáfora do computador é incompleta, já que raramente nos dizem como tais “computações” são realizadas: por exemplo, quais são os algoritmos para sentir surpresa ou medo, para se apaixonar ou cair da escada, para fazer perguntas ou criticar respostas. Tal imprecisão é característica de uma ciência imatura. É similar ao biólogo molecular que nos assegurou que as moléculas de DNA “especificam” proteínas (ou “instruem” sobre sua síntese), em vez de exibir as reações químicas correspondentes.

O computacionalismo é popular não apenas entre os fãs de computadores, mas também entre os psicólogos cognitivos e filósofos da mente que relutam em aprender um pouco de neurociência. Em contraste, os projetistas de computadores e engenheiros de robótica aprenderam há muito tempo que, para projetar máquinas de Inteligência Artificial melhores, eles precisam aprender mais sobre a inteligência natural. Afinal, não se pode imitar X a menos que se saiba algo sobre X. E uma das coisas que sabemos sobre a inteligência natural é que ela envolve memória, e que a memória humana, ao contrário da memória de computador, é reconstrutiva — empobrecedora ou enriquecedora, sempre distorcendo — em vez de replicadora.

Os filósofos parecem amar a metáfora do computador por duas razões. Primeiro, porque ela parece uma solução simples, racional e moderna para o antigo problema mente-corpo. Segundo, porque o computacionalismo é ontologicamente ambíguo: ele atrai o idealista (superficial) porque lhe assegura que a matéria não é importante, e também satisfaz o materialista porque lhe reafirma que os processos mentais são materiais. (De fato, o computacionalismo é hilomorfista, razão pela qual poderia satisfazer um aristotélico não cristão.)

Contudo, o idealista consistente não se deixará enganar, nem que seja porque essa visão neomecanicista da mente não abre espaço para a espontaneidade, o livre-arbítrio ou as criações livres — como Einstein caracterizou os conceitos teóricos. Tampouco o materialista emergentista se deixará enganar pelo computacionalismo, porque os cérebros vivos podem inventar truques qualitativamente novos, enquanto o objetivo de um processo programado é fixado antecipadamente pelo usuário. Não pode haver algo como espontaneidade programada e criatividade regrada, pela simples razão de que essas expressões são autocontraditórias.

Naturalmente, os computadores são similares aos cérebros humanos em alguns aspectos, mas são dissimilares na maioria deles. A diferença mais óbvia entre eles é que os cérebros, ao contrário dos computadores e das máquinas em geral, não carecem de iniciativa, enquanto os cérebros estão constantemente ativos mesmo na ausência de estimulação externa. Esse ponto é melhor apreciado recordando-se que a máquina de Turing, que é o modelo básico para o computador digital, não produz saídas a menos que receba algumas entradas. De fato, um dos postulados da teoria das máquinas de Turing afirma que, se uma máquina de Turing em um dado estado recebe a entrada nula, ela permanece nesse estado. Em símbolos óbvios: para cada s no alfabeto de entrada, M(s,0) = s, em que M é a função de transição ou próximo estado, e 0 designa a entrada nula. Em contraste, a função de transição para um cérebro vivo satisfaria algo assim: para cada estado s há outro estado t, tal que t ≠ s, e M(s,0) = t.

3. Crítica

O computacionalismo, a visão de que todos os processos mentais são operações sobre símbolos realizadas pelo cérebro de acordo com regras precisas (algoritmos), está aberto às seguintes objeções.

A vasta maioria das “computações” em questão são apenas simulações glorificadas, uma vez que raramente são especificadas. Portanto, afirmar que um pássaro, ou um acrobata, “computou” certo movimento corporal não é mais informativo do que dizer que ele ou ela o executou.

Ao contrário dos computadores, as pessoas e outros animais não são projetados: eles são produtos da evolução e da experiência. A distinção hardware-software não se aplica às pessoas, porque os processos mentais não podem ser separados do cérebro onde acontecem, exceto por abstração. O “software” humano cresce com a aprendizagem: ele está sujeito tanto ao desenvolvimento quanto à evolução. E as mentes não evoluem por si mesmas: apenas os cérebros que mentam evoluem. Portanto, o computacionalismo implica, equivocadamente, a irrelevância tanto da biologia do desenvolvimento quanto da biologia evolutiva para a psicologia.

Os programas de computador, ou algoritmos, não são coisas ou processos vivos, mas artefatos. Como as máquinas, eles são projetados e reparados, encomendados e vendidos, perdidos e roubados. Portanto, os algoritmos satisfazem não apenas certas leis, mas também certas normas técnicas (ou convenções), algumas das quais são inteligentes, mas outras nem tanto — razão pela qual estão continuamente sendo atualizados.

Apenas as computações rotineiras propriamente ditas são algorítmicas. Todos os outros processos mentais, desde sentir amor, medo ou ódio até adivinhar, inventar e criticar, são não algorítmicos. Em particular, não há regras conhecidas para ter boas ideias. Tampouco conhecemos as “computações neurais” que supostamente guiam as computações propriamente ditas.

Os psicólogos do processamento de informação usam livremente as palavras “informação” e “computação”, mas não fazem uso dos conceitos técnicos correspondentes, que são elucidados na teoria da comunicação de Shannon e na metamatemática, respectivamente. Portanto, seu discurso permanece em um nível intuitivo e metafórico. Na verdade, a psicologia do processamento de informação é apenas a psicologia clássica reescrita em informacionês.

Como o computacionalismo está exclusivamente interessado em processos racionais (e particularmente algorítmicos), ele corta as fortes ligações entre a cognição, de um lado, e a motivação, a emoção e a socialidade, de outro. Portanto, ele não pode explicar nem a curiosidade nem a aprendizagem, nem o fato de que as circunstâncias sociais ora estimulam, ora inibem a aprendizagem. Em contraste, a abordagem biológica da cognição exibe suas fortes interações com a emoção e o contexto social (por exemplo, Phelps 2006).

Ao contrário dos computadores, que são conservadores naturais projetados para obedecer, os humanos têm a capacidade de inovar, desobedecer e trapacear. Em particular, eles podem elaborar, discutir, criticar e colocar em prática regras de conduta, algumas das quais são princípios morais e outras, normas técnicas ou legais. E, embora quaisquer regras de conduta vivíveis sejam informadas pelo conhecimento, elas não são itens epistêmicos. Ademais, tais normas são motivadas e postas em ação por emoções sociais, como empatia, simpatia, piedade, vergonha, orgulho, confiança e desconfiança, que estão além do alcance das máquinas. Em suma, ao contrário das pessoas, os computadores não têm senso moral.

Outras capacidades além do alcance de quaisquer máquinas concebíveis, por não serem programáveis, são a capacidade de ser autoconsciente e autocrítico, de distinguir o essencial do secundário, de usar pistas, cortar caminhos, sugerir alternativas e compreender metáforas, a iniciativa (ou espontaneidade), a criatividade, o senso comum, a curiosidade, a intuição e o pensamento sistêmico (em oposição ao analítico ou setorial), e de lidar com a continuidade e o infinito atual (exceto como símbolos).

O computacionalismo ignora o fato de que, ao contrário dos computadores, os cérebros são sociais e aprendem por meio da interação, da adaptação, da cooperação e do conflito.

Por serem sociais, os cérebros humanos são intensionais de enésima ordem: eles podem vir a saber que alguém sabe que alguém sabe algo, e assim por diante. (A intensionalidade de primeira ordem é exemplificada pela autoconsciência, e ser capaz de formar uma “teoria da mente”, isto é, imaginar o que outras pessoas estão pensando, conta como intensionalidade de segunda ordem. Note-se a diferença entre intensão e intenção: a primeira está relacionada ao significado, enquanto a intenção está relacionada ao objetivo.)

O computacionalismo viola o primeiro princípio da filosofia da tecnologia. Esta é a tese de que as coisas feitas, ao contrário das encontradas, “incorporam” ideias, razão pela qual constituem um nível ontológico próprio: o das coisas feitas em vez de encontradas. (Ver outras limitações dos computadores em Bunge 1956a, 1985.)

Em suma, o computacionalismo não se sai melhor do que o dualismo cartesiano. A razão é que ele também se recusa a levar o cérebro a sério. Ambos são funcionalistas: adotam a dicotomia substância/função. Portanto, nenhum deles pode explicar coisa alguma, uma vez que a explicação consiste em exibir mecanismos. Basicamente, a psicologia sem cérebro não é melhor do que a cardiologia sem coração. (Mais sobre os modos e limitações do funcionalismo em Mahner e Bunge 2001.)

4. O software é bastante duro

Um computador não fará nada a menos que um usuário o alimente com um programa. Isto é, uma unidade artificial de processamento de informação é um sistema com três componentes: (a) um usuário com um cérebro treinado para operar computadores e, em particular, para codificar e decodificar mensagens — isto é, para emparelhar símbolos a significados; (b) um computador junto com sua fonte de energia; e (c) um programa de computador. Em suma, UPI = U + H + P. A remoção de qualquer um desses três componentes desabilita o sistema de processamento de informação UPI.

Um programa de computador especifica uma sequência de estados da máquina. Diz-se que ele é uma peça de software porque pode ser substituído por outro programa e inserido na mesma peça de hardware, para produzir uma unidade de processamento de informação diferente.

Ainda assim, a nomenclatura hardware/software é enganosa, porque o software é tão “duro” ou material quanto o hardware. É verdade que, ao contrário de um pedaço comum de matéria, uma peça de software tem um conteúdo semântico — ou melhor, ela evoca um. Mais precisamente, uma peça de software, quando inserida em um computador, evoca significados no cérebro do usuário. Portanto, o “conteúdo” de uma peça de software é muito diferente do conteúdo de uma garrafa: ele só pode ser vertido para dentro de um cérebro treinado — e apenas metaforicamente. Isto é, o software pertence ao nível semiótico da realidade, junto com as notas bancárias, as sentenças e os diagramas, nenhum dos quais cumpre sua função sem um cérebro capaz de compreender seu significado.

A distinção hardware/software feita na tecnologia da computação é útil, mas superficial. É útil porque se pode usar diferentes peças de software para ativar a mesma máquina. E também porque o design de software é conceitual e socialmente diferente do design da arquitetura de máquinas, a ponto de a maioria dos engenheiros de software, ao contrário de seus colegas de hardware, não possuírem diplomas de engenharia. Mas a distinção é ontologicamente rasa porque toda peça de software está materializada em um disco: a distinção em questão não envolve uma separação.

A distinção duro/mole é ainda menos justificável no caso dos animais, em particular dos humanos. Isso porque o “software” humano, a mente, é apenas uma coleção de funções cerebrais e estas, ao contrário das peças de software de computador, são indestacáveis do hardware ou cérebro. Ademais, enquanto o “software” cerebral cresce e decai com a experiência e a reflexão, uma peça de software de computador emerge plenamente desenvolvida e permanece inalterada em um disco. De fato, sabe-se desde o trabalho de Sir Frederick Bartlett em 1932 que a memória humana é tanto construtiva quanto destrutiva, a ponto de se poder “recordar” eventos que nunca aconteceram (ver Schacter 2001, Tulving 2002). Os computadores podem falhar, mas podem ser reparados, enquanto os cérebros podem se enriquecer até certo ponto, após o qual decaem sem possibilidade de reparo.

5. Máquina versus homem?

Acredita-se amplamente que os computadores podem substituir jogadores de xadrez e até mesmo matemáticos. Diz-se que o Deep Blue, a famosa máquina da IBM, derrotou o campeão mundial de xadrez Gary Kasparov. Mas isso é equivocado, porque a máquina foi programada pelo Dr. Feng-siung Hsu, também conhecido como CrazyBird; ademais, o programa era atualizado após cada jogada. O que de fato derrotou Kasparov não foi a máquina, mas o sistema composto pela máquina e pelo Dr. Hsu.

A alegação de que os computadores podem fazer matemática é igualmente equivocada: eles apenas processam correlatos físicos (eletromagnéticos) de conceitos matemáticos (Bunge 1956a). Ademais, tais correlações são convencionais. Em particular, as máquinas processam numerais, não os números que estes designam. (Ao contrário dos números, que têm propriedades conceituais, os numerais têm apenas propriedades físicas e químicas.) Por lidarem com nomes, não com conceitos, pode-se dizer que os computadores são máquinas nominalistas.

É verdade que alguns programas de computador provam teoremas a partir de axiomas e definições dados. Mas essas premissas precisam ser primeiro inventadas por matemáticos vivos. Também é verdade que tais máquinas são capazes de escolher entre estratégias alternativas — mas alguém precisa inventar tais estratégias, e programadores igualmente vivos precisam alimentá-las nas máquinas. Em geral, uma coisa é seguir um programa, e outra é escrever um completamente novo. Novamente, uma coisa é selecionar os meios mais adequados para atingir um objetivo dado, e outra bastante diferente é conceber um objetivo e toda uma família de meios para alcançá-lo.

Além disso, e isto é essencial, tudo o que um programa de computador pode fazer é ajudar a resolver um problema: as máquinas não podem descobrir novos problemas porque não há algoritmos para inventá-los ou descobri-los. E tais problemas, para serem enfrentados com a ajuda de um computador, precisam ser computacionais (programáveis). Contudo, a vasta maioria dos problemas matemáticos interessantes não são desse tipo. De fato, considere esta pequena amostra:

• Formalizar uma hipótese ou teoria enunciada em linguagem comum.

• Dados os primeiros termos de uma série infinita, adivinhar o termo geral.

• Inventar métodos para somar séries ou produtos infinitos, ou computar integrais.

• Dada uma função contínua, encontrar as equações diferenciais que ela satisfaz.

• Encontrar as premissas (axiomas, definições e lemas) que implicam uma proposição dada. (Isto é, dado B, encontrar um A tal que A ⊢ B.)

• Descobrir a teoria abstrata subjacente a duas teorias diferentes.

• Inventar novos algoritmos.

• Dado um conjunto de dados empíricos, inventar uma teoria (outra que não uma generalização indutiva) que dê conta deles.

Em suma, as máquinas não podem substituir os cérebros: no máximo, podem nos auxiliar na execução de algumas tarefas rotineiras. Em particular, a pesquisa científica não está sendo totalmente automatizada, uma vez que apenas as operações rotineiras são dirigidas por regras: encontrar problemas, inventar ideias e avaliar não podem ser programados.

Contudo, não há dúvida de que a disseminação da tecnologia da informação e da computação alterou a maneira como vivemos, pensamos, trabalhamos e interagimos. Basta olhar ao redor e você verá muitas pessoas falando ao celular ou enviando mensagens de texto — ocupadas demais para falar consigo mesmas, examinar suas próprias vidas e planejar. Mas isso acontece principalmente nos espaços públicos das cidades do mundo industrializado: não é típico do Terceiro Mundo, onde a vasta maioria das pessoas vive. A comunicação sempre foi coextensiva com a humanidade, uma vez que os humanos são essencialmente sociáveis. Mas não cultivamos, comemos, vestimos ou golpeamos bits. Portanto, não é verdade que a nossa é a sociedade da informação.

Sem dúvida, a vida se tornaria extremamente difícil nas nações industrializadas se todos os canais de comunicação fossem subitamente desligados. Mas ela não pararia: continuaríamos alimentando bebês, usando fontes de energia, cultivando vegetais, ordenhando vacas, transportando mercadorias, nos deslocando, estudando, jogando, e assim por diante. E, como compensação pelas coisas boas que os canais de informação entregam, seríamos poupados de todo o lixo cultural e veneno político que eles disseminam. Em suma, a sociedade contemporânea difere apenas em grau de sua ancestral de meio século atrás. E as diferenças nas interações sociais são ambíguas: os laços fracos (com estranhos) tornaram-se mais fortes, enquanto os fortes (com parentes e amigos) foram enfraquecidos, porque as cálidas interações face a face estão sendo substituídas pelas frias interações tela a tela.

Considerações finais

Os adoradores de computadores acreditam que o futuro da psicologia pertence à Inteligência Artificial. Isso é como dizer que o futuro da anatomia e da fisiologia humanas pertence à robótica. Como o objetivo da Inteligência Artificial e da robótica é nos imitar em alguns aspectos, elas podem avançar apenas na medida em que aprendem sobre os humanos a partir das ciências do homem. Em geral, para imitar qualquer coisa, comece aprendendo sobre o artigo genuíno.

O mesmo se aplica à moda atual da receita do “its from bits” na física popular: é errado tentar reduzir o natural ao artificial e, em particular, tentar basear a física na engenharia, em vez do contrário, e isso por duas razões. Primeiro, porque as máquinas e a engenharia são itens artificiais construídos por cérebros, que pertencem tanto à natureza quanto à cultura. Segundo, porque os conjuntos básicos da ciência da computação digital são enumeráveis, enquanto a realidade é contínua na maioria dos aspectos, razão pela qual as funções contínuas e as equações diferenciais têm sido tão bem-sucedidas na física e na engenharia.

Em suma, os computadores são úteis desde que sejam considerados auxiliares dos cérebros, não substitutos deles.

Referências

- Bartlett, Frederic. 1932. Remembering: A study in experimental and social psychology. Cambridge: Cambridge University Press.

- Bunge, Mario. 1956a. Do computers think? British Journal for the Philosophy of Science 7: 139–48; 7: 212–9. Reprinted in Bunge 1959b.

- Bunge, Mario. 1985. Treatise on basic philosophy, vol. 7, part II. Dordrecht, NL: Reidel.

- Bunge, Mario. 2006a. Chasing reality. Toronto: University of Toronto Press.

- Cattell, Raymond B. 1987. Intelligence: Its structure, growth, and action. Amsterdam: North Holland.

- Chaitin, Gregory. 2006. Meta Math! New York: Viking.

- Churchland, Patricia Smith, and Terrence J. Sejnowski. 1993. The computational brain. Cambridge, MA: MIT Press.

- Feferman, Solomon. 2009. Gödel, Nagel, minds, and machines. Journal of Philosophy 106: 201–19.

- Gallistel, C. R., and Adam Philip King. 2009. Memory and the computational brain: Why cognitive science will transform neuroscience. New York: Wiley and Blackwell.

- Mahner, Martin, and Mario Bunge. 2001. Function and functionalism: A synthetic perspective. Philosophy of Science 68: 75–94.

- McCulloch, Warren S. 1965. Embodiments of mind. Cambridge, MA: MIT Press.

- Mellor, D. H. 1991. Matters of metaphysics. Cambridge: Cambridge University Press.

- Phelps, Elizabeth A. 2006. Emotion and cognition. Annual Reviews of Psychology 57: 27–53.

- Putnam, Hilary. 1960. Minds and machines. In Dimensions of mind, ed. S. Hook, 148–79. New York: New York University Press.

- Pylyshyn, Zenon W. 1984. Computation and cognition. Cambridge, MA: MIT Press.

- Schacter, Daniel L. 2001. The seven sins of memory. Boston, MA: Houghton Mifflin.

- Schmidt, Michael, and Hod Lipson. 2009. Distilling free-form natural laws from experimental data. Science 324: 81–5.

- Searle, John. 1980. Minds, brains and programs. Behavioral and Brain Sciences 3: 417–57.

- Sejnowski, Terrence J., Christof Koch, and Patricia S. Churchland. 1988. Computational neuroscience. Science 241: 1299–306.

- Tulving, Endel. 2002. Episodic memory: From mind to brain. Annual Review of Psychology 53: 1–25.