Por Eva Hamrud

Publicado na Metafact

Encontramos Inteligência Artificial (IA) todos os dias. A IA descreve sistemas de computador que são capazes de realizar tarefas que normalmente requerem inteligência humana. Quando você pesquisa algo na internet, os principais resultados que você vê são decididos pela IA.

Todas as recomendações que você receber de seus sites de compras ou streaming favoritos também serão baseadas em um algoritmo de IA. Esses algoritmos usam o histórico do navegador para encontrar coisas que podem ser de seu interesse.

Como as recomendações direcionadas não são particularmente empolgantes, a ficção científica prefere retratar a IA como robôs superinteligentes que destroem a humanidade. Algumas pessoas acreditam que esse cenário pode um dia se tornar realidade. Figuras notáveis, incluindo o falecido Stephen Hawking, expressaram medo sobre como a IA do futuro poderia ameaçar a humanidade.

Para abordar essa preocupação, perguntamos a 11 especialistas em IA e Ciência da Computação: “A IA é uma ameaça existencial para a humanidade?”

Houve um consenso de 82 por cento de que não é uma ameaça existencial. Aqui está o que descobrimos.

Quão perto estamos de fazer uma IA que é mais inteligente do que nós?

A IA que existe atualmente é chamada de IA ‘fraca’. É amplamente utilizada para muitas aplicações, como reconhecimento facial, carros autônomos e recomendações da Internet. É definido como ‘fraca’ porque esses sistemas só podem aprender e executar tarefas muito específicas.

Eles geralmente realizam essas tarefas melhor do que os humanos – notoriamente, Deep Blue foi a primeira IA a vencer um campeão mundial de xadrez em 1997 – no entanto, eles não podem aplicar seu aprendizado a nada além de uma tarefa muito específica (Deep Blue só pode jogar xadrez).

Outro tipo de IA é chamada de Inteligência Artificial Geral (AGI). Ela é definida como uma IA que imita a inteligência humana, incluindo a capacidade de pensar e aplicar inteligência a vários problemas diferentes. Algumas pessoas acreditam que a AGI é inevitável e acontecerá em breve nos próximos anos.

Matthew O’Brien, engenheiro mecatrônico do Instituto de Tecnologia da Georgia (EUA) discorda, “o tão almejado objetivo de uma ‘IA geral’ não está no horizonte. Simplesmente não sabemos como fazer uma inteligência adaptável geral e não está claro quanto progresso a mais é preciso para chegar a esse ponto”.

Como uma futura AGI poderia ameaçar a humanidade?

Embora não esteja claro quando ou se a AGI acontecerá, podemos prever que ameaça eles podem representar para nós, humanos? A AGI aprende com a experiência e os dados, em vez de ser explicitamente informada sobre o que fazer. Isso significa que, quando nos deparamos com uma nova situação que não vimos antes, podemos não ser capazes de prever completamente como ela irá reagir.

O Dr. Roman Yampolskiy, cientista da computação da Universidade de Louisville (EUA), também acredita que “nenhuma versão do controle humano sobre o IA é possível”, pois não é possível que a IA seja autônoma e controlada por humanos. Não ser capaz de controlar sistemas superinteligentes pode ser desastroso.

Yingxu Wang, professor de Software e Ciências do Cérebro da Universidade de Calgary discorda, dizendo que “os sistemas e produtos de IA profissionalmente projetados são bem limitados por uma camada fundamental de sistemas operacionais para proteger o interesse e o bem-estar dos usuários, que não podem ser acessados ou modificados pelo próprias máquinas inteligentes.”

O Dr. O’Brien acrescenta “assim como com outros sistemas de engenharia, qualquer coisa com consequências potencialmente perigosas seria testada exaustivamente e teria várias verificações de segurança redundantes.”

A IA que usamos hoje pode se tornar uma ameaça?

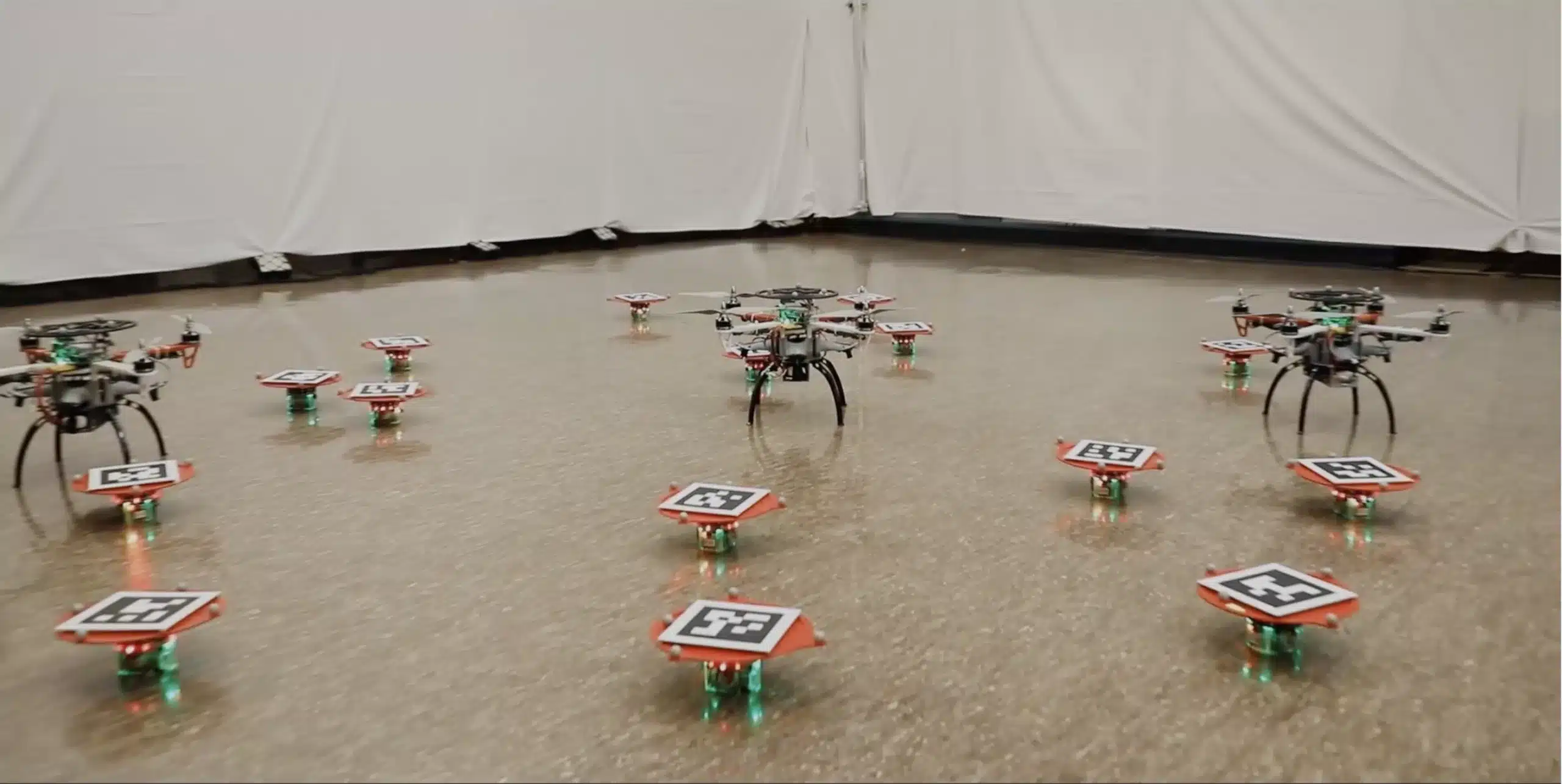

Muitos dos especialistas concordam que a IA pode ser uma ameaça nas mãos erradas. O Dr. George Montanez, especialista em IA do Harvey Mudd College destaca que “robôs e sistemas de IA não precisam ser sencientes para serem perigosos; eles apenas precisam ser ferramentas eficazes nas mãos de humanos que desejam prejudicar os outros. Essa é uma ameaça que existe hoje.”

Mesmo sem intenção maliciosa, a IA de hoje pode ser ameaçadora. Por exemplo, preconceitos raciais foram descobertos em algoritmos que alocam cuidados de saúde a pacientes nos Estados Unidos. Preconceitos semelhantes foram encontrados em software de reconhecimento facial usado em sistemas judiciais. Esses vieses têm impactos negativos abrangentes, apesar da capacidade ‘fraca’ da IA.

O viés da IA vem dos dados pelo qual ela é treinada. Nos casos de preconceito racial, os dados de treinamento não eram representativos da população em geral. Outro exemplo aconteceu em 2016, quando um bate-papo baseado em IA foi encontrado enviando conteúdo altamente ofensivo e racista. Descobriu-se que isso acontecia porque as pessoas estavam enviando mensagens ofensivas ao bot, com as quais ele aprendeu.

A lição:

A IA que usamos hoje é excepcionalmente útil para muitas tarefas diferentes.

Isso não significa que seja sempre positivo – é uma ferramenta que, se usada de forma maliciosa ou incorreta, pode ter consequências negativas. Apesar disso, atualmente parece improvável que se torne uma ameaça existencial para a humanidade.