Traduzido e adaptado por Mateus Lynniker de ScienceAlert

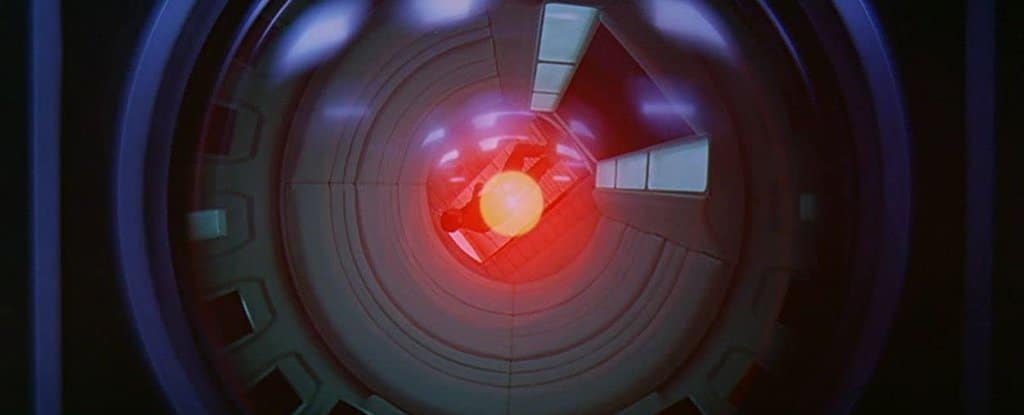

A ideia da inteligência artificial destronar a humanidade é falada há décadas – e programas como o ChatGPT apenas renovaram essas preocupações .

Então, qual a probabilidade de conseguirmos controlar a superinteligência de computadores de alto nível? Os cientistas em 2021 analisaram os números. A resposta? Quase definitivamente não.

O problema é que controlar uma superinteligência muito além da compreensão humana exigiria uma simulação dessa superinteligência que podemos analisar. Mas se não formos capazes de compreendê-lo, é impossível criar tal simulação.

Regras como ‘não causar danos aos humanos’ não podem ser definidas se não entendermos o tipo de cenário que uma IA criará, sugerem os autores do artigo. Uma vez que um sistema de computador está trabalhando em um nível acima do escopo de nossos programadores, não podemos mais estabelecer limites.

“Uma superinteligência representa um problema fundamentalmente diferente daqueles normalmente estudados sob a bandeira da ‘ética robótica’”, escreveram os pesquisadores em 2021.

“Isso ocorre porque uma superinteligência é multifacetada e, portanto, potencialmente capaz de mobilizar uma diversidade de recursos para atingir objetivos potencialmente incompreensíveis para os humanos, quanto mais controláveis”.

Parte do raciocínio da equipe vem do problema da parada apresentado por Alan Turing em 1936. O problema centra-se em saber se um programa de computador chegará ou não a uma conclusão e resposta (portanto, ele para), ou simplesmente fará um loop infinito tentando encontrar uma.

Como Turing provou por meio de alguma matemática inteligente , embora possamos saber isso para alguns programas específicos, é logicamente impossível encontrar uma maneira que nos permita saber isso para cada programa em potencial que poderia ser escrito.

Isso nos traz de volta à IA, que em um estado superinteligente poderia manter todos os programas de computador possíveis em sua memória ao mesmo tempo.

Qualquer programa escrito para impedir que a IA prejudique os humanos e destrua o mundo, por exemplo, pode chegar a uma conclusão (e parar) ou não – é matematicamente impossível termos certeza absoluta de qualquer maneira, o que significa que não pode ser contido.

“Na verdade, isso torna o algoritmo de contenção inutilizável”, disse o cientista da computação Iyad Rahwan , do Instituto Max-Planck para o Desenvolvimento Humano na Alemanha.

A alternativa para ensinar um pouco de ética à IA e dizer a ela para não destruir o mundo – algo que nenhum algoritmo pode ter certeza absoluta de fazer, dizem os pesquisadores – é limitar as capacidades da superinteligência. Pode ser cortado de partes da internet ou de certas redes, por exemplo.

O estudo de 2021 também rejeita essa ideia, sugerindo que isso limitaria o alcance da inteligência artificial – o argumento é que, se não vamos usá-la para resolver problemas além do alcance dos humanos, por que criá-la?

Se formos avançar com a inteligência artificial, talvez nem saibamos quando chega uma superinteligência além do nosso controle, tamanha é a sua incompreensibilidade. Isso significa que precisamos começar a fazer algumas perguntas sérias sobre as direções que estamos tomando.

De fato, no início deste ano, gigantes da tecnologia, incluindo Elon Musk e o cofundador da Apple, Steve Wozniak, assinaram uma carta aberta pedindo à humanidade que pausasse o trabalho com inteligência artificial por pelo menos 6 meses para que sua segurança pudesse ser explorada.

“Sistemas de IA com inteligência competitiva humana podem representar riscos profundos para a sociedade e a humanidade”, disse a carta aberta intitulada “Pause Giant AI Experiments”.

“Poderosos sistemas de IA devem ser desenvolvidos apenas quando estivermos confiantes de que seus efeitos serão positivos e seus riscos serão administráveis”, afirmou.